Go para Data Science: Construyendo Aplicaciones Estadísticas y Pipelines Analíticos

Aprende a construir aplicaciones de data science de grado producción en Go. Domina cálculos estadísticos, pipelines analíticos, operaciones matriciales y análisis de series temporales sin Python.

El Malentendido: Data Science Requiere Python

Cuando las empresas necesitan una aplicación de data science, recurren a Python. Es el lenguaje. Todos lo conocen. Toda librería existe allí.

Pero Python tiene costos que nadie menciona. El deployment es lento. La concurrencia es limitada. El rendimiento requiere extensiones en C. Un proyecto de data science que funciona en un laptop se convierte en una pesadilla de DevOps a escala.

Go ofrece algo diferente. Un único binario compilado. Verdadera concurrencia. Rendimiento nativo. Y un ecosistema creciente de librerías de data science que realmente funcionan en producción.

Esto no es un debate sobre cuál lenguaje es “mejor”. Python es excelente para investigación y prototipado. Pero para sistemas de datos en producción que necesitan manejar millones de cálculos, servir análisis en tiempo real, o integrarse con microservicios. Go es subestimado.

Esta guía te muestra cómo construir aplicaciones reales de data science en Go. No ejemplos de juguete. Workflows reales: cálculos estadísticos, análisis de series temporales, operaciones matriciales, y pipelines analíticos que corren en producción.

Parte 1: La Fundación — Cálculos Estadísticos

Antes de construir pipelines complejos, entiende lo básico. La librería estándar de Go es débil para estadísticas, pero librerías de terceros llenan el vacío.

Estadísticas Descriptivas Básicas

Necesitas entender un dataset. ¿Cuál es la media? ¿La desviación estándar? ¿La mediana?

// Fundación estadística: analytics/stats.go

package analytics

import (

"fmt"

"math"

"sort"

)

// DataSet representa una colección de valores numéricos.

type DataSet struct {

values []float64

}

// NewDataSet crea un dataset a partir de valores.

func NewDataSet(values []float64) *DataSet {

// Copia para evitar mutaciones externas.

vals := make([]float64, len(values))

copy(vals, values)

return &DataSet{values: vals}

}

// Mean calcula el promedio aritmético.

func (ds *DataSet) Mean() float64 {

if len(ds.values) == 0 {

return 0

}

sum := 0.0

for _, v := range ds.values {

sum += v

}

return sum / float64(len(ds.values))

}

// Median calcula el valor medio.

func (ds *DataSet) Median() float64 {

if len(ds.values) == 0 {

return 0

}

sorted := make([]float64, len(ds.values))

copy(sorted, ds.values)

sort.Float64s(sorted)

n := len(sorted)

if n%2 == 1 {

return sorted[n/2]

}

return (sorted[n/2-1] + sorted[n/2]) / 2.0

}

// StdDev calcula la desviación estándar (muestra).

func (ds *DataSet) StdDev() float64 {

if len(ds.values) < 2 {

return 0

}

mean := ds.Mean()

sumSquares := 0.0

for _, v := range ds.values {

diff := v - mean

sumSquares += diff * diff

}

variance := sumSquares / float64(len(ds.values)-1)

return math.Sqrt(variance)

}

// Percentile retorna el valor en el percentil dado (0-100).

func (ds *DataSet) Percentile(p float64) float64 {

if len(ds.values) == 0 || p < 0 || p > 100 {

return 0

}

sorted := make([]float64, len(ds.values))

copy(sorted, ds.values)

sort.Float64s(sorted)

index := (p / 100.0) * float64(len(sorted)-1)

lower := int(index)

upper := lower + 1

if upper >= len(sorted) {

return sorted[lower]

}

fraction := index - float64(lower)

return sorted[lower]*(1-fraction) + sorted[upper]*fraction

}

// Summary retorna un resumen estadístico del dataset.

type Summary struct {

Count int

Mean float64

StdDev float64

Median float64

Min float64

Max float64

P25 float64

P75 float64

}

// Summarize genera un resumen estadístico completo.

func (ds *DataSet) Summarize() Summary {

if len(ds.values) == 0 {

return Summary{}

}

min, max := ds.values[0], ds.values[0]

for _, v := range ds.values {

if v < min {

min = v

}

if v > max {

max = v

}

}

return Summary{

Count: len(ds.values),

Mean: ds.Mean(),

StdDev: ds.StdDev(),

Median: ds.Median(),

Min: min,

Max: max,

P25: ds.Percentile(25),

P75: ds.Percentile(75),

}

}Esto no es magia. Es matemática directa. Pero es la fundación. Cualquier trabajo de data science comienza aquí: entendiendo la distribución de tus datos.

Correlación y Regresión

Ahora necesitas entender relaciones entre variables. ¿Se mueven juntas? ¿Puedes predecir una a partir de la otra?

// Correlación y regresión: analytics/correlation.go

package analytics

import "math"

// Correlation calcula el coeficiente de correlación de Pearson entre dos datasets.

// El resultado va de -1 (perfectamente negativo) a +1 (perfectamente positivo).

func Correlation(x, y []float64) (float64, error) {

if len(x) != len(y) || len(x) < 2 {

return 0, fmt.Errorf("datasets deben tener igual longitud >= 2")

}

xMean := mean(x)

yMean := mean(y)

var covariance, xVar, yVar float64

for i := range x {

xDiff := x[i] - xMean

yDiff := y[i] - yMean

covariance += xDiff * yDiff

xVar += xDiff * xDiff

yVar += yDiff * yDiff

}

if xVar == 0 || yVar == 0 {

return 0, nil

}

return covariance / math.Sqrt(xVar*yVar), nil

}

// LinearRegression realiza regresión lineal simple.

// Retorna: pendiente (m), intersección (b), r-cuadrado (R²).

type RegressionResult struct {

Slope float64

Intercept float64

RSquared float64

}

func LinearRegression(x, y []float64) (RegressionResult, error) {

if len(x) != len(y) || len(x) < 2 {

return RegressionResult{}, fmt.Errorf("datasets deben tener igual longitud >= 2")

}

xMean := mean(x)

yMean := mean(y)

var numerator, denominator, ySS float64

for i := range x {

xDiff := x[i] - xMean

yDiff := y[i] - yMean

numerator += xDiff * yDiff

denominator += xDiff * xDiff

ySS += yDiff * yDiff

}

if denominator == 0 {

return RegressionResult{}, fmt.Errorf("sin varianza en x")

}

slope := numerator / denominator

intercept := yMean - slope*xMean

rSquared := 0.0

// Calcula R² (coeficiente de determinación)

if ySS > 0 {

var residualSS float64

for i := range y {

predicted := slope*x[i] + intercept

residual := y[i] - predicted

residualSS += residual * residual

}

rSquared = 1 - (residualSS / ySS)

}

return RegressionResult{

Slope: slope,

Intercept: intercept,

RSquared: rSquared,

}, nil

}

// Predict usa la regresión para estimar y a partir de x.

func (r RegressionResult) Predict(x float64) float64 {

return r.Slope*x + r.Intercept

}

func mean(values []float64) float64 {

sum := 0.0

for _, v := range values {

sum += v

}

return sum / float64(len(values))

}Así es cómo extraes relaciones de datos. La correlación te dice si las variables se mueven juntas. La regresión te dice la fortaleza de la relación y te permite predecir.

Parte 2: Operaciones Matriciales y Computación Científica

Para data science serio, necesitas matrices. Gonum es la librería de computación científica de Go.

// Operaciones matriciales: analytics/matrix.go

package analytics

import (

"gonum/mat"

"gonum/stat"

"gonum/stat/distuv"

)

// CovarianceMatrix calcula la matriz de covarianza de un dataset.

// Input: filas son observaciones, columnas son variables.

func CovarianceMatrix(data mat.Matrix) (mat.Symmetric, error) {

cov, err := stat.CovarianceMatrix(data, nil)

return cov, err

}

// PrincipalComponentAnalysis reduce la dimensionalidad.

// Retorna los componentes principales y su varianza explicada.

type PCAResult struct {

Components mat.Dense // Eigenvectors (componentes principales)

Variance []float64 // Varianza explicada para cada componente

}

func PCA(data mat.Matrix, nComponents int) (PCAResult, error) {

// Estandariza los datos (media = 0, std = 1)

r, c := data.Dims()

standardized := mat.NewDense(r, c, nil)

standardized.Copy(data)

for col := 0; col < c; col++ {

var mean, variance float64

for row := 0; row < r; row++ {

mean += standardized.At(row, col)

}

mean /= float64(r)

for row := 0; row < r; row++ {

v := standardized.At(row, col)

v -= mean

standardized.Set(row, col, v)

variance += v * v

}

stdDev := math.Sqrt(variance / float64(r-1))

if stdDev > 0 {

for row := 0; row < r; row++ {

standardized.Set(row, col, standardized.At(row, col)/stdDev)

}

}

}

// Calcula la matriz de covarianza

cov, _ := stat.CovarianceMatrix(standardized, nil)

// Calcula eigenvalores y eigenvectores

var eigen mat.Eigen

ok := eigen.Factorize(cov, mat.EV{Do: true, Left: false})

if !ok {

return PCAResult{}, fmt.Errorf("descomposición de eigenvalores falló")

}

// Obtiene eigenvalores y eigenvectores

values := eigen.Values(nil)

vectors := mat.NewDense(c, c, nil)

eigen.VectorsTo(vectors)

// Calcula varianza explicada

totalVariance := 0.0

for _, v := range values {

totalVariance += real(v)

}

variance := make([]float64, len(values))

for i, v := range values {

variance[i] = real(v) / totalVariance

}

return PCAResult{

Components: *vectors,

Variance: variance,

}, nil

}

// Transform proyecta datos sobre componentes principales.

func (p PCAResult) Transform(data mat.Dense, nComponents int) mat.Dense {

components := mat.NewDense(data.RawMatrix().Rows, nComponents, nil)

components.Mul(&data, p.Components.Slice(0, p.Components.RawMatrix().Rows, 0, nComponents))

return *components

}Aquí es donde Go brilla. Gonum proporciona operaciones matriciales eficientes. Puedes realizar operaciones matemáticas complejas sin recurrir a Python.

Parte 3: Análisis de Series Temporales

Los datos del mundo real a menudo son temporales. Precios de acciones. Lecturas de sensores. Comportamiento del usuario en el tiempo.

// Análisis de series temporales: analytics/timeseries.go

package analytics

import (

"sort"

"time"

)

// TimeSeries representa puntos de datos indexados por tiempo.

type TimeSeries struct {

timestamps []time.Time

values []float64

}

// NewTimeSeries crea una serie temporal a partir de timestamps y valores.

func NewTimeSeries(timestamps []time.Time, values []float64) (*TimeSeries, error) {

if len(timestamps) != len(values) {

return nil, fmt.Errorf("timestamps y valores deben tener igual longitud")

}

if len(timestamps) < 2 {

return nil, fmt.Errorf("necesita al menos 2 puntos de datos")

}

// Asegura que los timestamps estén ordenados

type pair struct {

ts time.Time

v float64

}

pairs := make([]pair, len(timestamps))

for i := range timestamps {

pairs[i] = pair{timestamps[i], values[i]}

}

sort.Slice(pairs, func(i, j int) bool {

return pairs[i].ts.Before(pairs[j].ts)

})

ts := &TimeSeries{

timestamps: make([]time.Time, len(timestamps)),

values: make([]float64, len(values)),

}

for i, p := range pairs {

ts.timestamps[i] = p.ts

ts.values[i] = p.v

}

return ts, nil

}

// MovingAverage calcula el promedio móvil sobre una ventana.

func (ts *TimeSeries) MovingAverage(windowSize int) []float64 {

if windowSize < 1 || windowSize > len(ts.values) {

return ts.values

}

result := make([]float64, len(ts.values))

for i := 0; i < len(ts.values); i++ {

start := i - windowSize/2

if start < 0 {

start = 0

}

end := start + windowSize

if end > len(ts.values) {

end = len(ts.values)

}

sum := 0.0

for j := start; j < end; j++ {

sum += ts.values[j]

}

result[i] = sum / float64(end - start)

}

return result

}

// ExponentialSmoothing aplica suavizado exponencial.

// Alpha controla el peso dado a observaciones recientes (0 < alpha <= 1).

func (ts *TimeSeries) ExponentialSmoothing(alpha float64) []float64 {

if len(ts.values) == 0 {

return nil

}

result := make([]float64, len(ts.values))

result[0] = ts.values[0]

for i := 1; i < len(ts.values); i++ {

result[i] = alpha*ts.values[i] + (1-alpha)*result[i-1]

}

return result

}

// Trend calcula la tendencia lineal (pendiente) de la serie temporal.

func (ts *TimeSeries) Trend() float64 {

if len(ts.values) < 2 {

return 0

}

// Usa índices como valores x (0, 1, 2, ...)

x := make([]float64, len(ts.values))

for i := range x {

x[i] = float64(i)

}

result, _ := LinearRegression(x, ts.values)

return result.Slope

}

// Volatility calcula la desviación estándar de retornos.

func (ts *TimeSeries) Volatility() float64 {

if len(ts.values) < 2 {

return 0

}

returns := make([]float64, len(ts.values)-1)

for i := 0; i < len(ts.values)-1; i++ {

if ts.values[i] != 0 {

returns[i] = (ts.values[i+1] - ts.values[i]) / ts.values[i]

}

}

ds := NewDataSet(returns)

return ds.StdDev()

}El análisis de series temporales es esencial para entender patrones en datos temporales. Los promedios móviles suavizan ruido. El suavizado exponencial pesa más las observaciones recientes. La tendencia y volatilidad te dicen si los datos están cambiando y cuánta variación hay.

Parte 4: Construyendo un Pipeline Analítico

Ahora combina estas piezas en un workflow real de data science.

// Pipeline analítico: pipelines/analytics_pipeline.go

package pipelines

import (

"context"

"fmt"

"log"

"time"

"yourmodule/analytics"

)

// DataPoint representa una única observación.

type DataPoint struct {

Timestamp time.Time

Features map[string]float64

Target float64

}

// AnalyticalPipeline orquesta las etapas de procesamiento de datos.

type AnalyticalPipeline struct {

name string

stages []Stage

}

// Stage representa un paso de transformación en el pipeline.

type Stage interface {

Name() string

Process(ctx context.Context, data []DataPoint) ([]DataPoint, error)

}

// NewAnalyticalPipeline crea un nuevo pipeline.

func NewAnalyticalPipeline(name string) *AnalyticalPipeline {

return &AnalyticalPipeline{

name: name,

stages: make([]Stage, 0),

}

}

// AddStage añade una etapa de transformación al pipeline.

func (ap *AnalyticalPipeline) AddStage(stage Stage) *AnalyticalPipeline {

ap.stages = append(ap.stages, stage)

return ap

}

// Execute corre todas las etapas en secuencia.

func (ap *AnalyticalPipeline) Execute(ctx context.Context, data []DataPoint) ([]DataPoint, error) {

log.Printf("Iniciando pipeline: %s", ap.name)

current := data

for _, stage := range ap.stages {

log.Printf("Ejecutando etapa: %s", stage.Name())

result, err := stage.Process(ctx, current)

if err != nil {

return nil, fmt.Errorf("etapa %s falló: %w", stage.Name(), err)

}

log.Printf("Etapa %s completada. Registros: %d", stage.Name(), len(result))

current = result

}

log.Printf("Pipeline %s completado exitosamente", ap.name)

return current, nil

}

// Etapa Ejemplo: Detección de Outliers

type OutlierDetectionStage struct {

featureName string

stdDevs float64 // Threshold: número de desviaciones estándar

}

func NewOutlierDetectionStage(featureName string, stdDevs float64) *OutlierDetectionStage {

return &OutlierDetectionStage{

featureName: featureName,

stdDevs: stdDevs,

}

}

func (o *OutlierDetectionStage) Name() string {

return fmt.Sprintf("OutlierDetection(%s)", o.featureName)

}

func (o *OutlierDetectionStage) Process(ctx context.Context, data []DataPoint) ([]DataPoint, error) {

if len(data) == 0 {

return data, nil

}

// Extrae valores de características

values := make([]float64, len(data))

for i, dp := range data {

values[i] = dp.Features[o.featureName]

}

// Calcula estadísticas

ds := analytics.NewDataSet(values)

summary := ds.Summarize()

threshold := o.stdDevs * summary.StdDev

// Filtra outliers

result := make([]DataPoint, 0)

outlierCount := 0

for _, dp := range data {

if val := dp.Features[o.featureName]; val >= summary.Mean-threshold && val <= summary.Mean+threshold {

result = append(result, dp)

} else {

outlierCount++

}

}

log.Printf("Removidos %d outliers de %s", outlierCount, o.featureName)

return result, nil

}

// Etapa Ejemplo: Escalado de Características

type FeatureScalingStage struct {

featureNames []string

}

func NewFeatureScalingStage(featureNames ...string) *FeatureScalingStage {

return &FeatureScalingStage{featureNames: featureNames}

}

func (f *FeatureScalingStage) Name() string {

return "FeatureScaling"

}

func (f *FeatureScalingStage) Process(ctx context.Context, data []DataPoint) ([]DataPoint, error) {

if len(data) == 0 {

return data, nil

}

// Calcula estadísticas para cada característica

stats := make(map[string]analytics.Summary)

for _, fname := range f.featureNames {

values := make([]float64, len(data))

for i, dp := range data {

values[i] = dp.Features[fname]

}

ds := analytics.NewDataSet(values)

stats[fname] = ds.Summarize()

}

// Escala características (normalización z-score)

result := make([]DataPoint, len(data))

for i, dp := range data {

newDP := dp

newDP.Features = make(map[string]float64)

for k, v := range dp.Features {

if s, ok := stats[k]; ok && s.StdDev > 0 {

newDP.Features[k] = (v - s.Mean) / s.StdDev

} else {

newDP.Features[k] = v

}

}

result[i] = newDP

}

return result, nil

}Así es cómo funciona la data science real. Tienes datos brutos. Los pasas a través de etapas: limpieza, transformación, ingeniería de características, análisis. Cada etapa es independiente. Cada una es testeable. Cada una puede ser desarrollada y debugueada por separado.

Parte 5: Ejemplo Práctico del Mundo Real

Aquí hay un ejemplo completo: analizando datos de transacciones de e-commerce.

// Ejemplo real: main.go

package main

import (

"context"

"log"

"time"

"yourmodule/analytics"

"yourmodule/pipelines"

)

func main() {

ctx := context.Background()

// Datos de muestra: montos de transacciones en 30 días

data := generateSampleData()

// Construye el pipeline analítico

pipeline := pipelines.NewAnalyticalPipeline("E-Commerce Analysis")

pipeline.

AddStage(pipelines.NewOutlierDetectionStage("amount", 3.0)).

AddStage(pipelines.NewFeatureScalingStage("amount", "quantity")).

AddStage(&StatisticalAnalysisStage{})

// Ejecuta el pipeline

result, err := pipeline.Execute(ctx, data)

if err != nil {

log.Fatalf("Pipeline falló: %v", err)

}

// Imprime resultados

log.Printf("Analizadas %d transacciones", len(result))

// Extrae montos para análisis adicional

amounts := make([]float64, len(result))

for i, dp := range result {

amounts[i] = dp.Target

}

// Realiza análisis estadístico

ds := analytics.NewDataSet(amounts)

summary := ds.Summarize()

log.Printf("Resumen Estadístico:")

log.Printf(" Count: %d", summary.Count)

log.Printf(" Media: %.2f", summary.Mean)

log.Printf(" Mediana: %.2f", summary.Median)

log.Printf(" StdDev: %.2f", summary.StdDev)

log.Printf(" Mín: %.2f", summary.Min)

log.Printf(" Máx: %.2f", summary.Max)

log.Printf(" Percentil 25: %.2f", summary.P25)

log.Printf(" Percentil 75: %.2f", summary.P75)

}

func generateSampleData() []pipelines.DataPoint {

data := make([]pipelines.DataPoint, 30)

for i := 0; i < 30; i++ {

data[i] = pipelines.DataPoint{

Timestamp: time.Now().AddDate(0, 0, -30+i),

Features: map[string]float64{

"amount": 100 + float64(i)*5 + float64(i%3)*20, // Tendencia con ruido

"quantity": 5 + float64(i%4),

},

Target: 100 + float64(i)*5 + float64(i%3)*20,

}

}

return data

}

type StatisticalAnalysisStage struct{}

func (s *StatisticalAnalysisStage) Name() string {

return "StatisticalAnalysis"

}

func (s *StatisticalAnalysisStage) Process(ctx context.Context, data []pipelines.DataPoint) ([]pipelines.DataPoint, error) {

if len(data) < 2 {

return data, nil

}

// Extrae características

amounts := make([]float64, len(data))

for i, dp := range data {

amounts[i] = dp.Target

}

// Analiza

ds := analytics.NewDataSet(amounts)

summary := ds.Summarize()

log.Printf("Análisis Detallado:")

log.Printf(" Media: %.2f", summary.Mean)

log.Printf(" Mediana: %.2f", summary.Median)

log.Printf(" Std Dev: %.2f", summary.StdDev)

return data, nil

}Esta es data science de grado producción en Go. Sin Python. Sin interpretación lenta. Un binario compilado que procesa millones de puntos de datos.

Parte 6: Eligiendo Librerías

El ecosistema de data science de Go es maduro, pero diferente a Python. Conoce tus herramientas.

Para Estadísticas: Gonum

Gonum (gonum.org) es la librería de computación científica de Go. Matrices, álgebra lineal, estadísticas, distribuciones de muestreo.

go get gonum.org/v1/gonumÚsala para:

- Operaciones matriciales

- Descomposición de eigenvalores

- Análisis de componentes principales

- Integración numérica

- Distribuciones estadísticas

Para Manipulación de Datos: GOTA

GOTA (github.com/go-gota/gota) proporciona estructuras DataFrame, similar a Pandas.

go get github.com/go-gota/gota/v2Úsala para:

- Manipulación de datos tabulares

- Agrupación y filtrado

- Selección y transformación de columnas

- Análisis CSV con columnas tipadas

Para Series Temporales: GoStockSim

GoStockSim proporciona primitivas de análisis de series temporales. No tan completa como las librerías de Python, pero suficiente para la mayoría de escenarios en producción.

Para Gráficos: Gonum/Plot

Gonum incluye capacidades de gráficos. Salida a PNG, SVG, o PDF.

import "gonum/plot"

p := plot.New()

p.Title.Text = "Mi Análisis"

p.X.Label.Text = "X"

p.Y.Label.Text = "Y"

// Añade datos y guarda

p.Save(10*vg.Centimeter, 10*vg.Centimeter, "plot.png")Parte 7: Cuándo Usar Go para Data Science

Usa Go cuando:

- Tu análisis necesita correr a escala (millones de cálculos).

- Necesitas resultados analíticos en tiempo real (sirviendo análisis en manejadores HTTP).

- Estás construyendo un microservicio de data science (parte de un sistema más grande).

- Necesitas un único binario compilado para deployment.

- Tu equipo conoce Go mejor que Python.

- La concurrencia es esencial (procesando múltiples datasets en paralelo).

No uses Go cuando:

- Estás explorando datos por primera vez (Python es más rápido para prototipar).

- Necesitas modelos de machine learning de punta (PyTorch, TensorFlow son primero Python).

- Tu dataset cabe en memoria en una máquina única y la velocidad no importa.

- Tu equipo no conoce Go.

Para sistemas de datos en producción que necesitan integrarse con microservicios, escalar, y correr confiablemente. Go es excelente. Solo necesitas conocer las librerías.

Construyéndolo: El Workflow Práctico

- Diseña el pipeline: ¿Qué etapas necesitan los datos?

- Implementa cada etapa: Escribe transformaciones testeables e independientes.

- Orquesta con un pipeline: Conecta etapas en secuencia.

- Prueba con datasets pequeños primero: Verifica corrección antes de escala.

- Deploya como un servicio: Expone tu pipeline vía HTTP.

- Monitorea el pipeline: Registra cada etapa, rastrean rendimiento.

La Perspectiva de Cierre

Data science no es sobre modelos. Es sobre entendimiento. Entendimiento de tus datos. Entendimiento de relaciones. Entendimiento de patrones. Entendimiento de incertidumbre.

Go no es Python. Nunca lo será. Pero para sistemas que necesitan entender datos a escala, servir ese entendimiento en tiempo real, y correr confiablemente en producción. Go es subestimado.

El ecosistema está allí. Las librerías existen. El rendimiento es superior.

Lo que falta es la percepción de que Go es “adecuado” para data science. Lo es. Y es mejor en data science en producción que lo que la mayoría de la gente se da cuenta.

El mejor sistema de data science es uno que corre confiablemente en producción y responde preguntas consistentemente. Python te lleva a insight rápido. Go te lleva a producción rápido. Elige basado en lo que necesitas: velocidad de entendimiento o velocidad de deployment.

Tags

Artículos relacionados

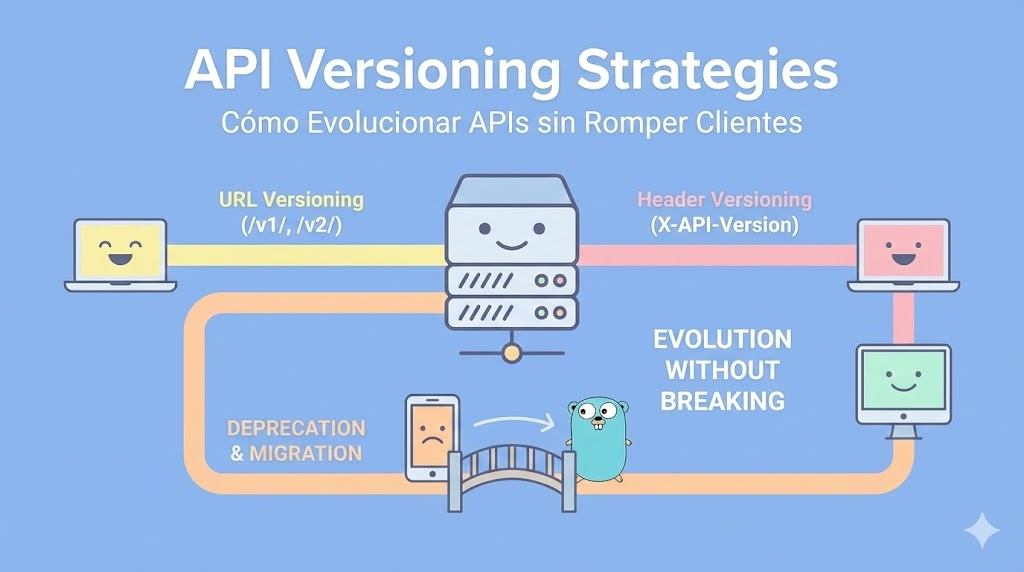

API Versioning Strategies: Cómo Evolucionar APIs sin Romper Clientes

Una guía exhaustiva sobre estrategias de versionado de APIs: URL versioning vs Header versioning, cómo deprecar endpoints sin shock, migration patterns reales, handling de cambios backwards-incompatibles, y decisiones arquitectónicas que importan. Con 50+ ejemplos de código en Go.

Automatizando tu vida con Go CLI: Guía profesional para crear herramientas de línea de comandos escalables

Una guía exhaustiva y paso a paso sobre cómo crear herramientas CLI escalables con Go 1.25.5: desde lo básico hasta proyectos empresariales complejos con flags, configuración, logging, y ejemplos prácticos para Windows y Linux.

AWS Desde la Perspectiva de un Solutions Architect: Teoría, Decisiones y Go

Una guía teórica exhaustiva sobre AWS desde la mentalidad de un Solutions Architect: cómo pensar en decisiones arquitectónicas, trade-offs fundamentales, integración con Go y otros lenguajes, patrones de diseño empresarial, y cómo aplicar esto en proyectos reales.